- Macroambiente

- 5' di lettura

Supporto ai non vedenti: le funzionalità dell'applicazione Lookout di Google e altre app

Google ha lanciato l'applicazione Lookout che sfrutta l'intelligenza artificiale per dare un supporto alle persone con disabilità visiva.

Ci sono al mondo circa 253 milioni di persone non vedenti o ipovedenti e oggigiorno tanti sono i siti e le applicazioni che vanno incontro alle loro esigenze. L’obiettivo dell’applicazione Lookout, per esempio, è sfruttare l’intelligenza artificiale per donare maggiore autonomia e indipendenza a questi individui che spesso si ritrovano ad affrontare tanti ostacoli per svolgere compiti quotidiani.

L’applicazione lanciata da Google a marzo 2019 si rivela molto utile, dunque, per facilitare la realizzazione di diverse attività da parte dei non vedenti. In realtà anche Microsoft in passato si era mossa in questa direzione con il lancio nel 2017 di Seeing IA, applicazione tra l’altro aggiornata recentemente con nuove funzionalità.

A cosa serve l’applicazione Lookout?

Lookout è stata pensata per aiutare le persone con disabilità visiva in situazioni in cui avrebbero bisogno di chiedere aiuto a qualcuno, come «quando si ritrovano per la prima volta in un posto, quando leggono testi e documenti e quando svolgono dei compiti come cucinare, pulire o fare shopping», come si può leggere sul blog di Google. In che modo però l’applicazione Lookout riesce a far ciò? Aiutando non vedenti e ipovedenti a identificare gli oggetti presenti nell’ambiente circostante mediante l’utilizzo della fotocamera dello smartphone che fornisce così all’applicazione le immagini degli oggetti da riconoscere.

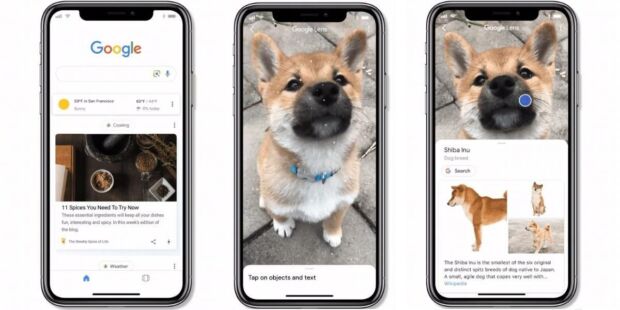

A livello tecnologico non si tratta in realtà di una novità. Infatti, l’applicazione Lookout si basa su una tecnologia simile a quella di Google Lens, applicazione (disponibile anche in Italia) che consente la ricerca basata sul riconoscimento delle immagini, grazie alla quale basta fotografare un oggetto e aspettare che l’app lo identifichi e che riporti i risultati di ricerca simili all’oggetto fotografato (per esempio immagini o informazioni su cani della stessa razza di quello fotografato).

Applicazione Google Lens. Fonte: Metro Jornal

Applicazione Lookout: come si usa?

Google suggerisce di mantenere il cellulare con la mano, di tenerlo appeso al collo con un porta cellulare oppure di inserirlo nel taschino di un indumento, tenendo la fotocamera scoperta: in questo modo l’app fornisce indicazioni vocali (o earcon, ossia suoni brevi usati per rappresentare eventi specifici o fornire altre informazioni) su persone, oggetti o testi presenti su cartelloni o indicazioni stradali che l’utente si ritrova intorno spostandosi.

Come spiegato nell’articolo di Google, l’applicazione Lookout consente all’utente di focalizzarsi sul compito che sta svolgendo, senza distrarsi per prendere il cellulare o premere dei pulsanti: basta che la camera del cellulare sia puntata in avanti.

L’applicazione mette a disposizione tre modalità: la “modalità di esplorazione“, cioè quella di riconoscimento degli oggetti che si ritrovano intorno all’utente; la “modalità di shopping“, che consente la lettura di codice a barre e prezzi; la “modalità di lettura veloce“, che consente lo smistamento della posta, la lettura di segnali stradali o di etichette.

Applicazione Lookout. Fonte: Google

Lookout è stata annunciata lo scorso anno ed è ora disponibile su Google Play anche se, al momento, esclusivamente per i dispositivi Google Pixel negli Stati Uniti e soltanto in lingua inglese. La speranza è che a breve l’applicazione Lookout possa essere disponibile anche in Europa, nelle diverse lingue, perché la sua utilità per persone con disabilità visiva è evidente. A questo proposito Google dichiara di voler estendere Lookout «a più dispositivi, paesi e piattaforme».

Ovviamente l’applicazione in questione ha dei limiti ed è soggetta a errori sui quali Google promette di continuare a lavorare: proprio per questo l’azienda chiede il feedback, sul funzionamento di Lookout, degli utenti che l’hanno già utilizzata, in modo da capire come migliorarla ulteriormente.

“Sii i miei occhi”: la partnership tra Google e Be My Eyes

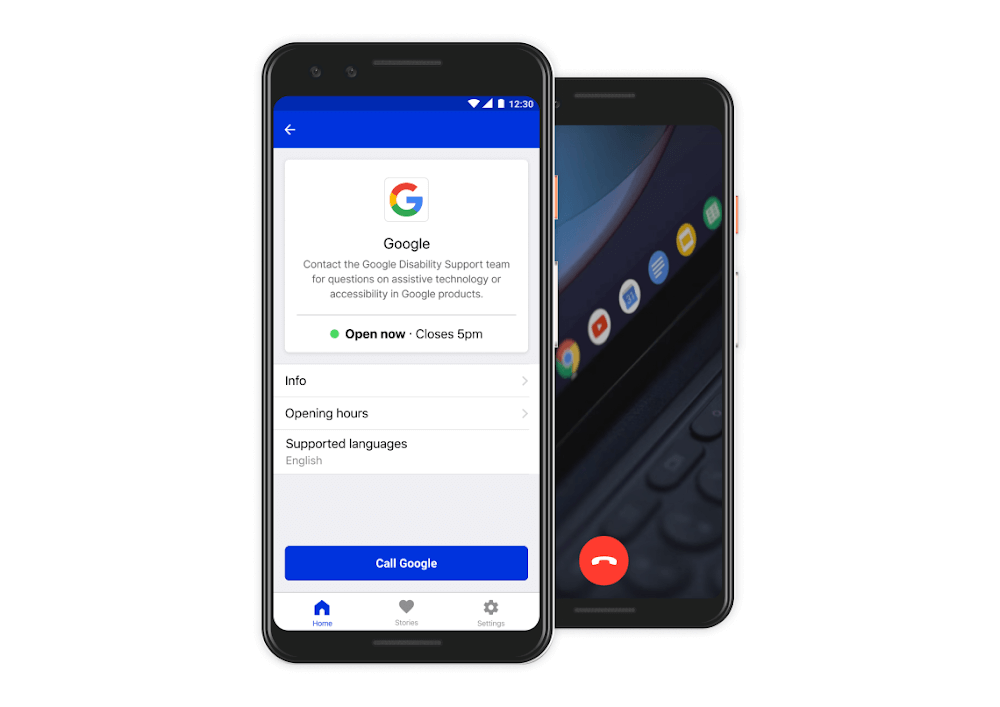

La mission di Google prevede, quindi, anche che si lavori per rendere più autonome le persone con disabilità. Per questo motivo a gennaio 2019, Google ha lanciato il Disability Support Team. Il team in questione è stato creato per rispondere a tutte le problematiche relative alle funzionalità di supporto alla disabilità presenti nei prodotti dell’azienda.

Fonte: Google

Gli utenti hanno così possibilità di parlare telefonicamente con un esperto di questo team negli orari stabiliti e in lingua inglese.

Grazie poi alla partnership tra Google e l’applicazione gratuita Be My Eyes, gli utenti possono accedere alla sezione di assistenza di quest’app e richiedere aiuto per l’utilizzo delle funzionalità sopracitate, così come per lo svolgimento di svariate attività. Infatti, l’applicazione consente alle persone non vedenti o ipovedenti di connettersi con circa 2 milioni di volontari normovedenti appartenenti alla comunità Be My Eyes; essi sono pronti ad aiutarli svolgendo compiti che richiedono un aiuto visivo: dal controllare le date di scadenza di prodotti al distinguere i colori, fino a leggere le istruzioni o assicurarsi che l’abbigliamento dell’utente sia ben abbinato.

Una volta che l’utente normovedente disponibile al momento risponde alla richiesta di aiuto, i due vengono messi in contatto tramite videochiamata e il primo in questo modo può fornire le informazioni richieste dal secondo.

Seeing IA: l’app di supporto ai non vedenti (presente anche in Italia)

Del resto, sempre più aziende comprendono l’importanza di trovare soluzioni tecnologiche accessibili a tutti e in grado di rendere più semplice la vita delle persone con disabilità di diversi tipi. Non solo Google quindi, ma anche un’azienda come Microsoft ha deciso di sfruttare l’intelligenza artificiale per creare un’app con delle funzionalità simili a quelle dell’applicazione Lookout.

Nel 2017 in effetti Microsoft ha lanciato un’interessante applicazione, chiamata Seeing IA, che può essere usata in vari contesti, per esempio per riconoscere e leggere le etichette dei prodotti o i menu dei ristoranti oppure per descrivere le persone, dalla loro età e dal loro genere al loro stato emotivo.

A marzo 2019 Microsoft ha lanciato un aggiornamento dell’app, introducendo una funzione che consente all’utente di ascoltare la descrizione del contenuto di fotografie relative all’ambiente circostante, della galleria del cellulare o altre immagini condivise sui social media . Per ora Seeing IA è presente solo su iOS e solo in lingua inglese, ma è già disponibile in Italia.

- Accessibilità dei siti web: come creare dei siti fruibili da tutti gli utenti

- Iniziative di corporate social responsibility e sostenibilità aziendale: cosa lega brand e consumatori

- Quando investire in diversità e inclusione è utile per il business

- Perché serve il commitment dei brand contro le discriminazioni razziali?

Notizie correlate

Stampa da app: una soluzione vantaggiosa in molte circostanze

Tecnologia: le tre principali tendenze per il 2024

Come cambierà quest’anno la customer experience tra AI e soluzioni personalizzate

IT, automation, martech: quali saranno le tendenze per il 2024?

Intelligenza artificiale: le principali tendenze per il 2024