- Macroambiente

- 5' di lettura

Così l’Europa prova a combattere l’hate speech (ma non ci riesce)

Da maggio 2016 c’è un codice europeo contro l'hate speech. Cos’è successo da allora? Quali sono i limiti dello strumento contro l’odio online?

Un tavolo di lavoro con giganti dell’IT come Facebook, Twitter, YouTube, Microsoft, l’esigenza di confrontarsi con un tema delicato quale quello del flaming, dell’incitamento all’odio razziale, religioso, politico, sessuale e di discriminazioni e abusi a cui ogni giorno sono esposti gli internauti: è così che nel maggio 2016 è nato il primo codice europeo contro l’ hate speech . Codice che obbliga le aziende che offrono servizi online a prendere in carico entro 24 ore le segnalazioni di contenuti inappropriati ed eventualmente cancellarli.

A che cosa è servito il codice europeo contro l’hate speech?

Da allora sono passati oltre sei mesi e dalla Commissione europea giunge un primo bilancio sull’effettivo funzionamento del codice contro l’hate speech. A dicembre 2016 le segnalazioni erano state circa seicento (i dati sono riferiti all’azione di dodici organizzazioni non governative operanti in nove Stati Membri, ndr). La maggior parte riguardava Facebook (45%) e Twitter (27%) e solo il resto era riferibile ad altre compagnie come YouTube (21%) e simili. I contenuti segnalati avevano natura antisemita (nel 23,7% dei casi) o nazionalista (21%), erano riconducibili al fronte anti-islamico (20.2%) o, più in generale, erano espressione di odio razziale (11.7%). Circa il 30% di questi è stato rimosso e, forse un po’ a sorpresa, tra i contenuti cancellati la maggior parte proveniva non da persone comuni ma da utenti noti ( influencer , professionisti dell’informazione, ecc.). Nessuna delle aziende in questione, però, sembra aver raggiunto l’obiettivo di valutare la segnalazione entro le 24 ore.

Fonte: Valigia Blu

Fonte: Valigia Blu

Una definizione (im)possibile…

Il codice europeo contro l’hate speech, del resto, non è vincolante neanche per le aziende che hanno preso parte al tavolo dei lavori. E questo è, secondo gli esperti in materia, solo uno dei limiti dell’iniziativa della Commissione europea che sconta, in primis, una mancanza definitoria. Cosa si intende, infatti, per hate speech e cosa far rientrare in questa definizione? Il codice sembra muoversi in una zona grigia nell’intento di prevenire già qualsiasi tipo di espressione che, pur non essendo una vera e propria incitazione diretta alla violenza, prepari un terreno di odio razziale, religioso, politico, sociale, ecc. Non si può dimenticare, del resto, che il codice è figlio del clima di intolleranza e terrore che ha colpito l’Europa post Charlie Hebdo.

…e i limiti del codice europeo contro l’hate speech

La soluzione proposta dalla Commissione europea è, insomma, il primo embrionale tentativo di rendere il web e i suoi luoghi più frequentati, più civili e rispettosi delle diversità, pur con tutti i limiti che gli osservatori più critici – in Italia ci ha pensato Valigia Blu – non si sono fatti scappare.

- Il codice europeo contro l’hate speech infatti non ha una solida base giuridica: non esiste, in altre parole, un diritto dell’Unione Europea in materia. Che comportamenti possono essere considerati legali, on e offline, e quali no varia, così, in maniera consistente di paese in paese. Basti pensare che solo in alcuni Stati Membri l’incitazione alla violenza o l’apologia di nazi-fascismo, per esempio, sono considerate reato.

- Il codice, insomma, delega ad aziende private funzioni che dovrebbero essere per definizione statali: Facebook e simili non potranno che valutare la legittimità dei contenuti a partire dalle proprie linee guida, l’unico standard di comunità che hanno a disposizione.

- Non si tratta, allora, tanto di una violazione della libertà d’espressione del singolo che, come pure molti hanno fatto notare, è giustificata in ambito europeo solo in casi eccezionali ed emergenziali e, comunque, per obbligo giuridico, mentre di fatto il codice in questione la legherebbe alle condizioni di servizio privato.

- Si tratta piuttosto di sottolineare l’arbitrarietà del giudizio: chiamato a valutare la legittimità o meno di un contenuto sarà un dipendente dei big dell’IT in questione che avrà, naturalmente, formazione, conoscenze, sensibilità personali. Ciò potrebbe portare a un quadro di incertezza e di applicazione parziale dello stesso codice contro l’hate speech, del resto confermato dal fatto che, secondo i risultati avuti fin qua, almeno due terzi delle segnalazioni si è concluso con un nulla di fatto.

- Chi è più pratico di questioni giuridiche potrebbe sottolineare, a questo punto, che nessun giudice è veramente imparziale (tanto più in sistemi come la maggior parte di quelli europei in cui non c’è la vincolatività dei precedenti, ndr). Coinvolgere attori pubblici nella valutazione di contenuti portatori di odio, però, assicurerebbe maggiore trasparenza e la possibile partecipazione dei soggetti coinvolti. Oltre che alimentare, in maniera positiva e istruttiva, il dibattito pubblico.

- Una delle priorità del codice contro l’hate speech avrebbe sollevato, per finire, non pochi dubbi. Si farebbe riferimento, infatti, alla necessità di «identificare e promuovere le contro-narrazioni». L’intento è nobile e non è difficile intravedere il bisogno di dar spazio nel discorso pubblico anche alle minoranze politiche, culturali, sociali. Il rischio dietro l’angolo, però, è quello di manipolare il normale flusso dell’informazione, tanto più che alla ricerca di contenuti quanto più targettizzati possibile aziende come Facebook e simili hanno già algoritmi che premiano le affinità tra utenti, le interazioni reciproche, ecc. È il vecchio spauracchio, insomma, della bolla omofila in cui gli ambienti digitali farebbero sprofondare i loro utenti.

Lo scenario italiano: un manifesto contro le “parole ostili” e la lettera della Boldrini

Sono limiti come questi che dimostrano come l’hate speech e l’odio sui social si combattano prima di tutto con un approccio soft. Serve ricostruire, insomma, una cultura dell’accettazione dell’altro e delle sue opinioni e della responsabilità sulle proprie. Per farlo è necessaria la collaborazione di tutti, professionisti dell’informazione e non. Così, per esempio, è nato il Manifesto della comunicazione non ostile, un documento partecipato anche nella costruzione (cento esperti in materia hanno proposto i loro principi contro le “parole ostili” del web e tutti hanno avuto l’opportunità di votare online i più importanti fino alla costituzione del manifesto vero e proprio, ndr) e che sarà il primo esperimento italiano contro i toni esasperati della comunicazione 2.0. È stata diffusa, inoltre, una lettera con cui la Presidente della Camera Laura Boldrini si è rivolta a Mark Zuckerberg dicendosi «preoccupata per il dilagare dell’odio nel discorso pubblico. Fenomeno non generato certo dai social network, ma che in essi ha un veicolo di diffusione potenzialmente universale». Ad essere rimproverato al CEO di Facebook è un certo laissez-faire con cui ha affrontato la questione fin qui, soprattutto nell’ottica di alcuni casi recenti di cronaca nostrana. La Boldrini ha ribadito, insomma, di credere nello straordinario potere dei social, ma sembra chiedere a Zuckerberg e al suo team un impegno più serio e operativo perché «i social non diventino ostaggio dei violenti».

Notizie correlate

Microsoft chiuderà LinkedIn in Cina dopo le critiche ricevute per aver censurato dei giornalisti americani

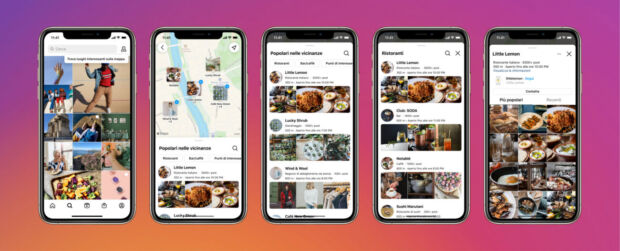

Su Instagram arriva la funzione “Cerca sulla mappa” per scoprire nuove attività e luoghi d’interesse

Reazioni ai messaggi WhatsApp: tutto quello che c’è da sapere sulla nuova funzione in arrivo

Pinterest annuncia nuove opportunità per la monetizzazione dei contenuti: in arrivo Pin Idea acquistabili e partnership con i brand

Su Instagram arrivano le inserzioni di Reels: un nuovo modo per raggiungere il proprio pubblico